决策树模型1

决策树分类

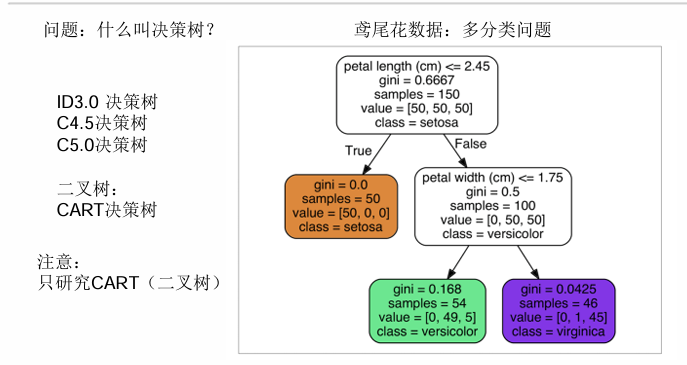

决策树是什么

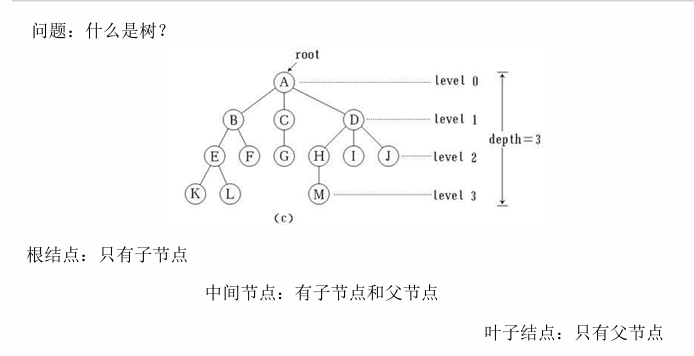

- 树:如图,分位根节点、中间结点、叶子结点。

注意树的深度不算根节点。树 - 决策树:针对多个指标进行多次划分,最后划分为一类。

包含二叉树——每一次只划分两类。

根节点:包含所有样本、划分的属性、划分的阈值。

内部节点:包含划分后的样本、下一步划分的属性、划分的阈值。

叶子结点:在这个决策路径下最后包含的样本。决策树

决策树特点

- 支持多分类

- 支持输出概率

决策树核心

CART决策树有两个核心:

- 如何选择划分的特征?

- 如何选择划分的阈值?

- 贪心策略:每一次划分都要使得两边的子集都足够纯,足够单一。

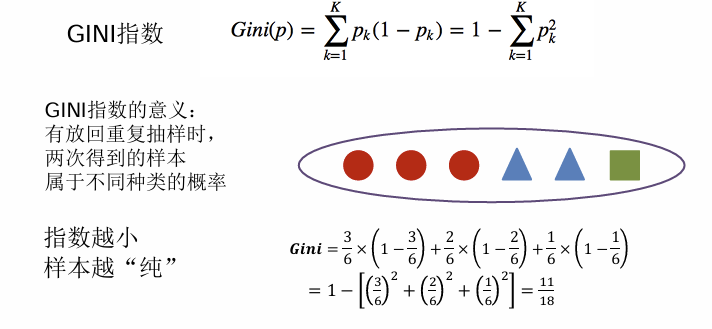

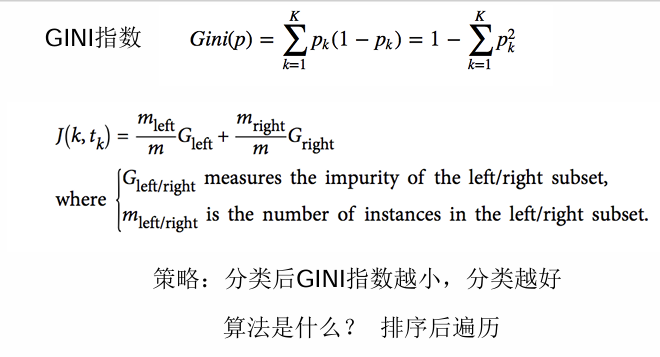

- 使用GINI指数进行判断。

GINI越小,样本越纯,分的越好。gini指数 - 如何使用?

- 比较分类前GINI和分类后GINI加权和,越小越好

- 贪心策略,多次改变分类条件,让GINI最小

- 最小化分类后GINI加权和

- 数学表达

如图,多设置几个阈值,排序后遍历,选最小的即可。算gini

决策树回归

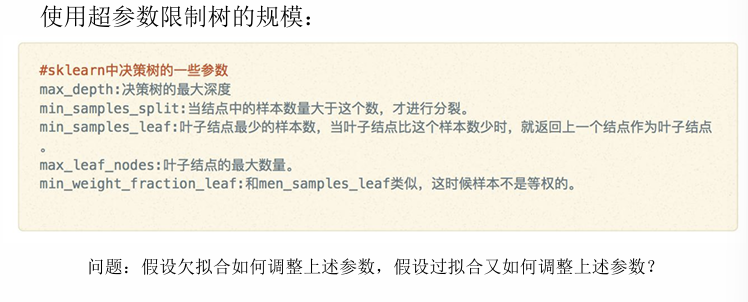

决策树参数

如图。

最大深度:越大,模型越复杂,可以控制欠拟合、过拟合。

简单来讲max开头越大,趋向于过拟合。min开头越大,趋向于欠拟合。